Whisper是OpenAI开发的通用语音识别模型,具有以下特点:

支持多语言语音识别、语音翻译和语言识别在大规模、多样化的音频数据集上训练采用Transformer序列到序列模型架构开源代码和模型权重,使用MIT许可证发布

可以通过pip安装Whisper:

pip install -U openai-whisper或者从GitHub安装最新版本:

pip install git+https://github.com/openai/whisper.git使用medium模型转录音频文件:

whisper audio.mp3 --model medium指定语言和翻译任务:

whisper japanese.wav --language Japanese --task translateWhisper提供了5种不同大小的模型,适用于不同的场景:

模型参数量内存需求相对速度tiny39M~1GB~32xbase74M~1GB~16xsmall244M~2GB~6xmedium769M~5GB~2xlarge1550M~10GB1x其中tiny、base、small和medium模型还提供英语专用版本。

Whisper是一个功能强大、易于使用的语音识别工具,希望这些资源能帮助你快速上手并充分利用它的能力。如果你在使用过程中有任何问题,欢迎查阅官方文档或在GitHub上提问。

tortoise-tts学习资料汇总 - 高质量多声音TTS系统

2024-12-31

PaddleSpeech入门学习资料汇总 - 开源语音AI工具包

2025-01-02

pot-desktop使用指南 - 跨平台划词翻译和OCR软件

2025-01-02

understand-prompt学习资料汇总 - AI助手的探索与应用

2025-01-02

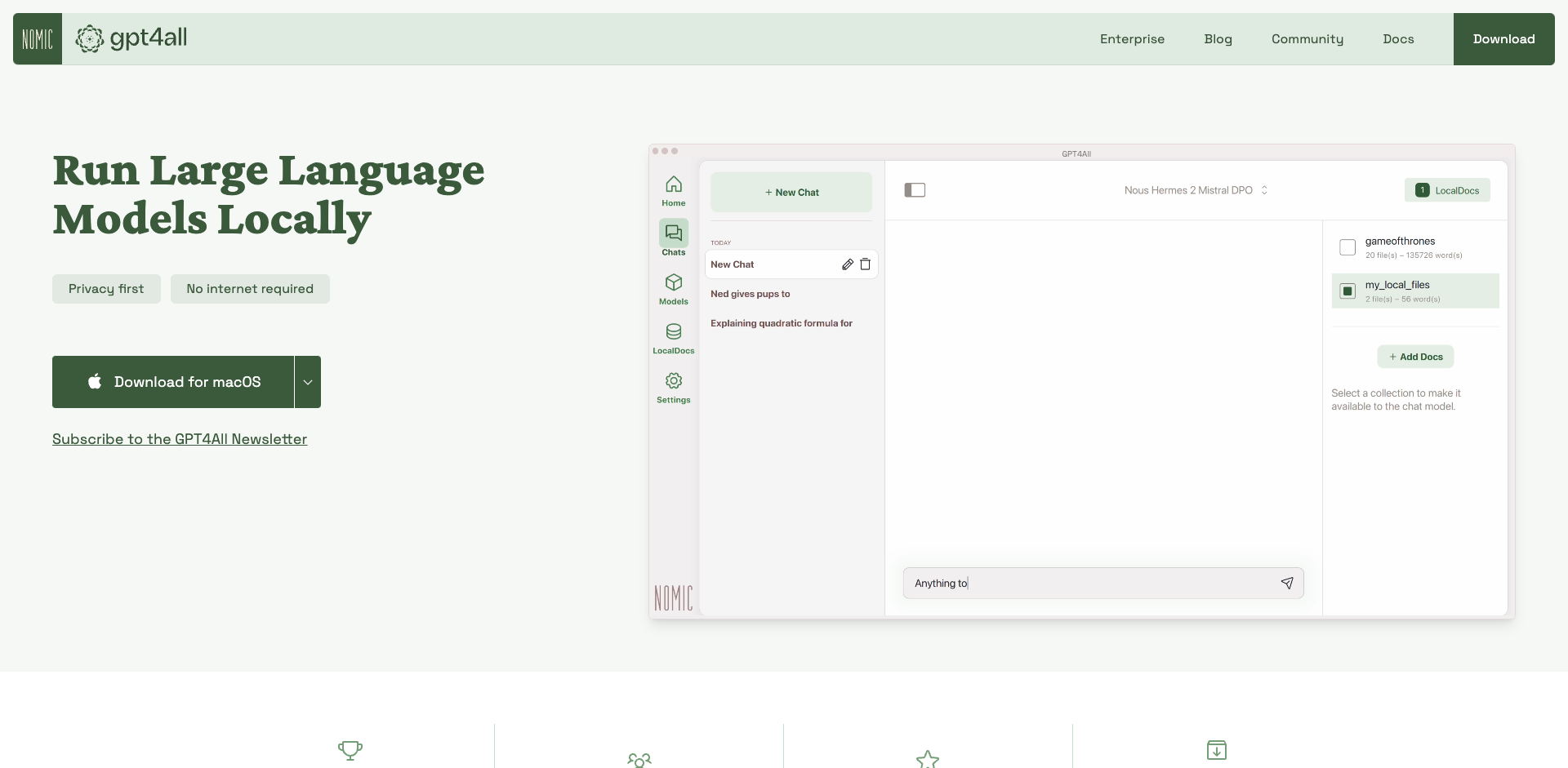

GPT4All学习资源汇总 - 在本地设备上运行大型语言模型

2025-01-02

2025-01-02

wechat-bot入门指南 - 基于ChatGPT的微信聊天机器人

2025-01-02

Cheetah - AI助手学习资料汇总 - Mac应用助力远程技术面试

2025-01-02

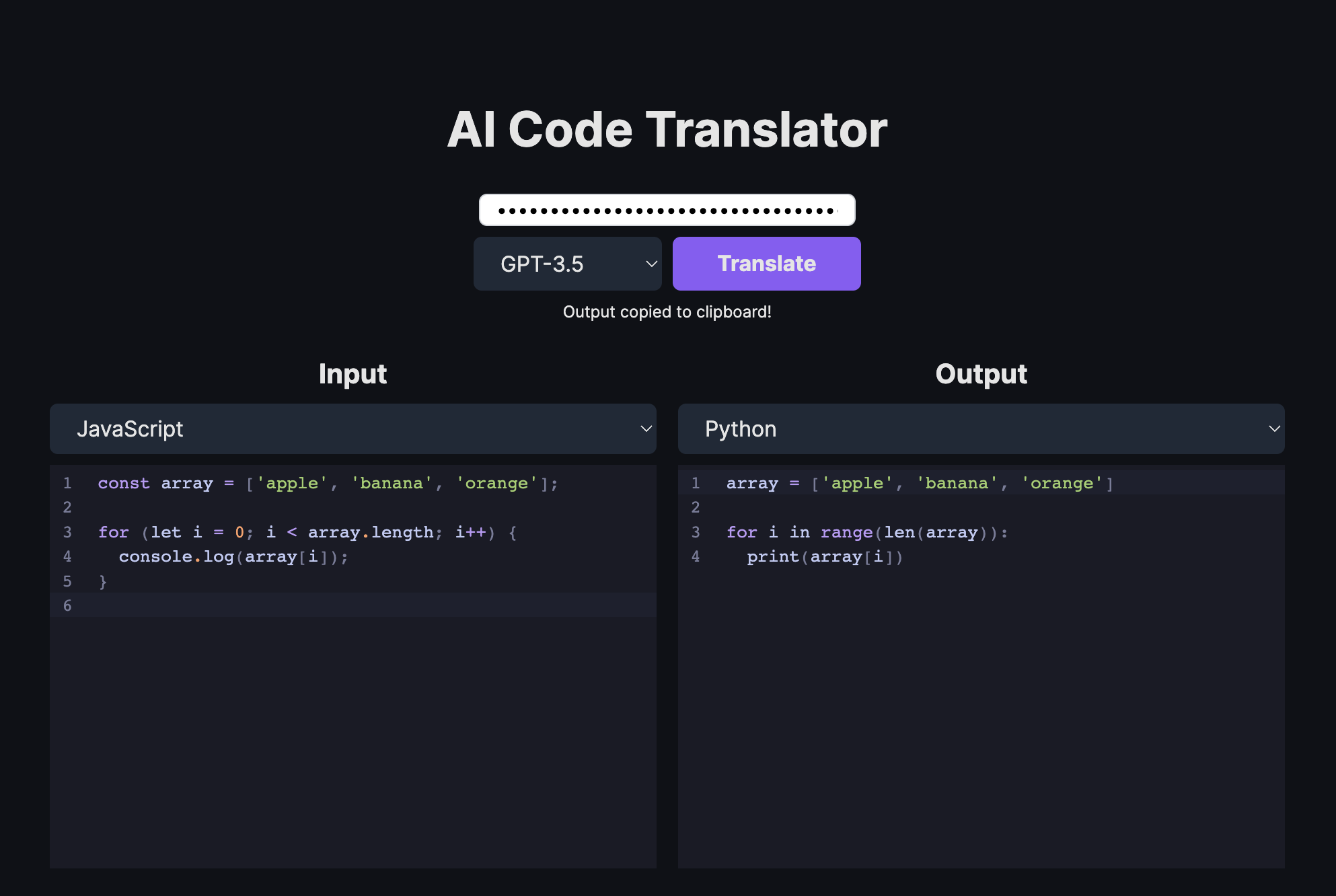

AI代码翻译器学习资料汇总 - 使用AI将代码从一种语言翻译成另一种语言

2025-01-02