VLMEvalKit入门指南 - 开源大规模视觉语言模型评估工具包

更新时间:2025-01-27来源:互联网

VLMEvalKit简介

VLMEvalKit是一个由开源贡献者开发的大规模视觉语言模型(LVLM)评估工具包。它具有以下主要特点:

支持对约100种视觉语言模型进行评估,包括API模型和开源PyTorch/Hugging Face模型提供40多个基准数据集,涵盖图像理解、视频理解等多个任务采用基于生成的评估方法,并提供精确匹配和基于LLM的答案提取两种评估模式一键式评估,无需繁琐的数据准备工作支持自定义基准和模型,易于扩展主要功能

支持的视觉语言模型VLMEvalKit支持多种类型的视觉语言模型:

API模型:如GPT-4v、Gemini Pro Vision等开源PyTorch/HF模型:如IDEFICS、LLaVA、MiniGPT-4等支持多模态输入的模型(标记为-

下一篇: 最后一页

相关文章

更多

- VLMEvalKit入门指南 - 开源大规模视觉语言模型评估工具包

- VALL-E-X学习资料汇总 - 微软多语言零样本文本转语音模型

- CNTK入门学习资料 - 微软开源深度学习工具包

- readme-ai使用指南-AI驱动的README生成工具

- so-vits-svc-fork学习资料汇总 - 支持实时转换的AI变声工具

- ml5.js学习资源汇总 - 让机器学习变得友好易用的JavaScript库

- Chinese-LLaMA-Alpaca学习资源汇总:中文LLaMA&Alpaca大语言模型+本地CPU/GPU训练部署

- Open-source LLMs 入门指南 - 开放大语言模型项目一句话介绍

- InternVL入门学习资料 - 开源多模态大模型系列

- Chinese-LLaMA-Alpaca-3学习资料汇总 - 基于Meta Llama 3的优秀中文开源大模型

近期热点

-

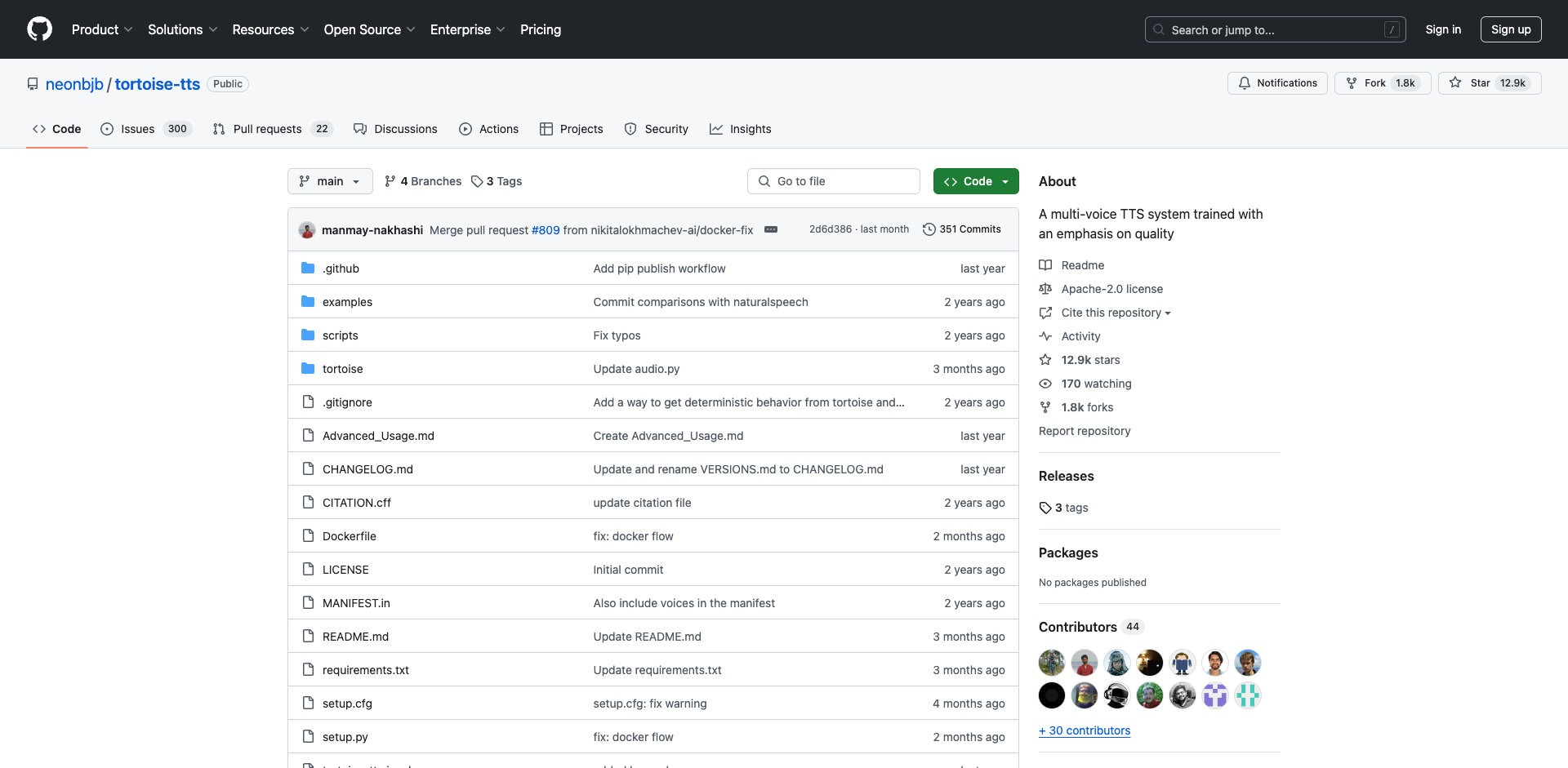

tortoise-tts学习资料汇总 - 高质量多声音TTS系统

2024-12-31

-

-

PaddleSpeech入门学习资料汇总 - 开源语音AI工具包

2025-01-02

-

pot-desktop使用指南 - 跨平台划词翻译和OCR软件

2025-01-02

-

understand-prompt学习资料汇总 - AI助手的探索与应用

2025-01-02

-

GPT4All学习资源汇总 - 在本地设备上运行大型语言模型

2025-01-02

-

2025-01-02

-

wechat-bot入门指南 - 基于ChatGPT的微信聊天机器人

2025-01-02

-

Cheetah - AI助手学习资料汇总 - Mac应用助力远程技术面试

2025-01-02

-

AI代码翻译器学习资料汇总 - 使用AI将代码从一种语言翻译成另一种语言

2025-01-02

热门文章

-

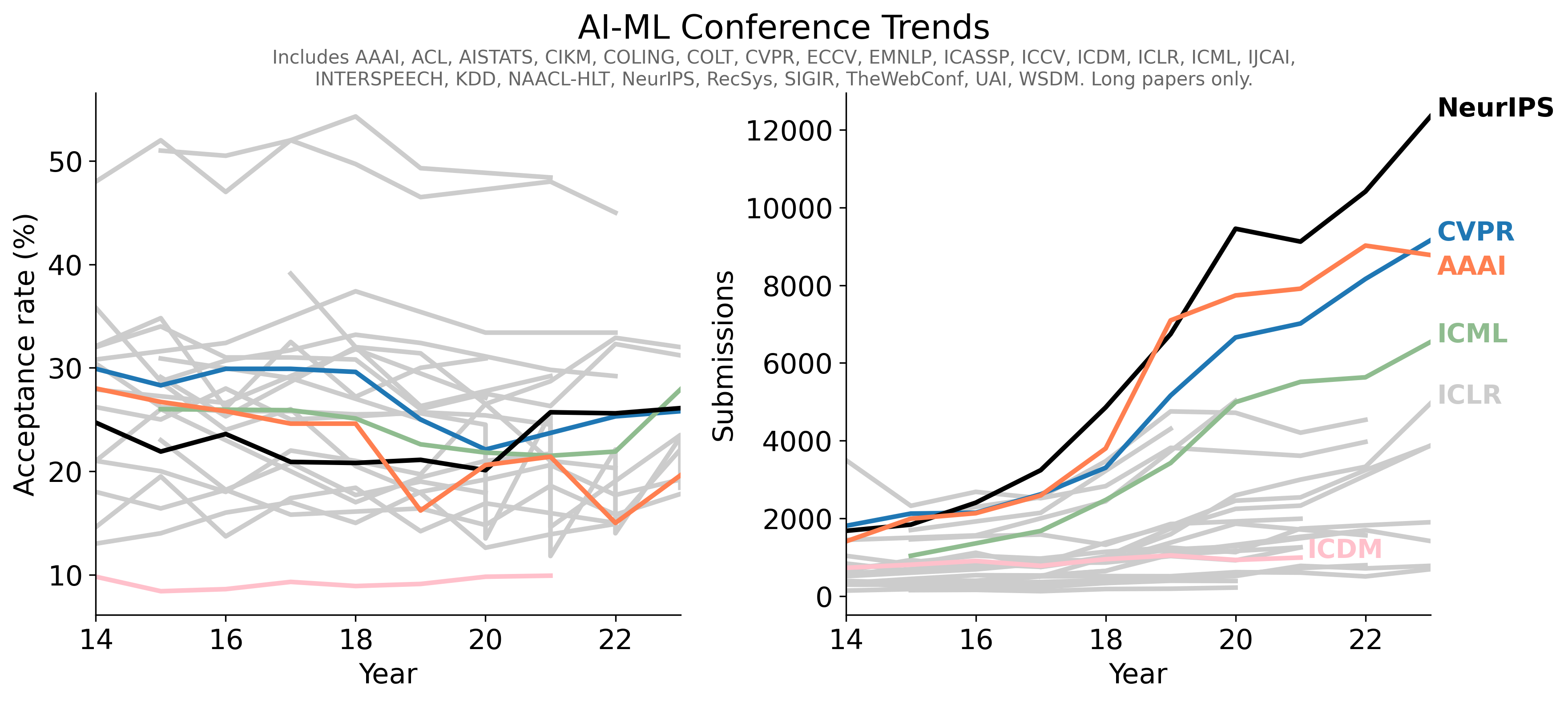

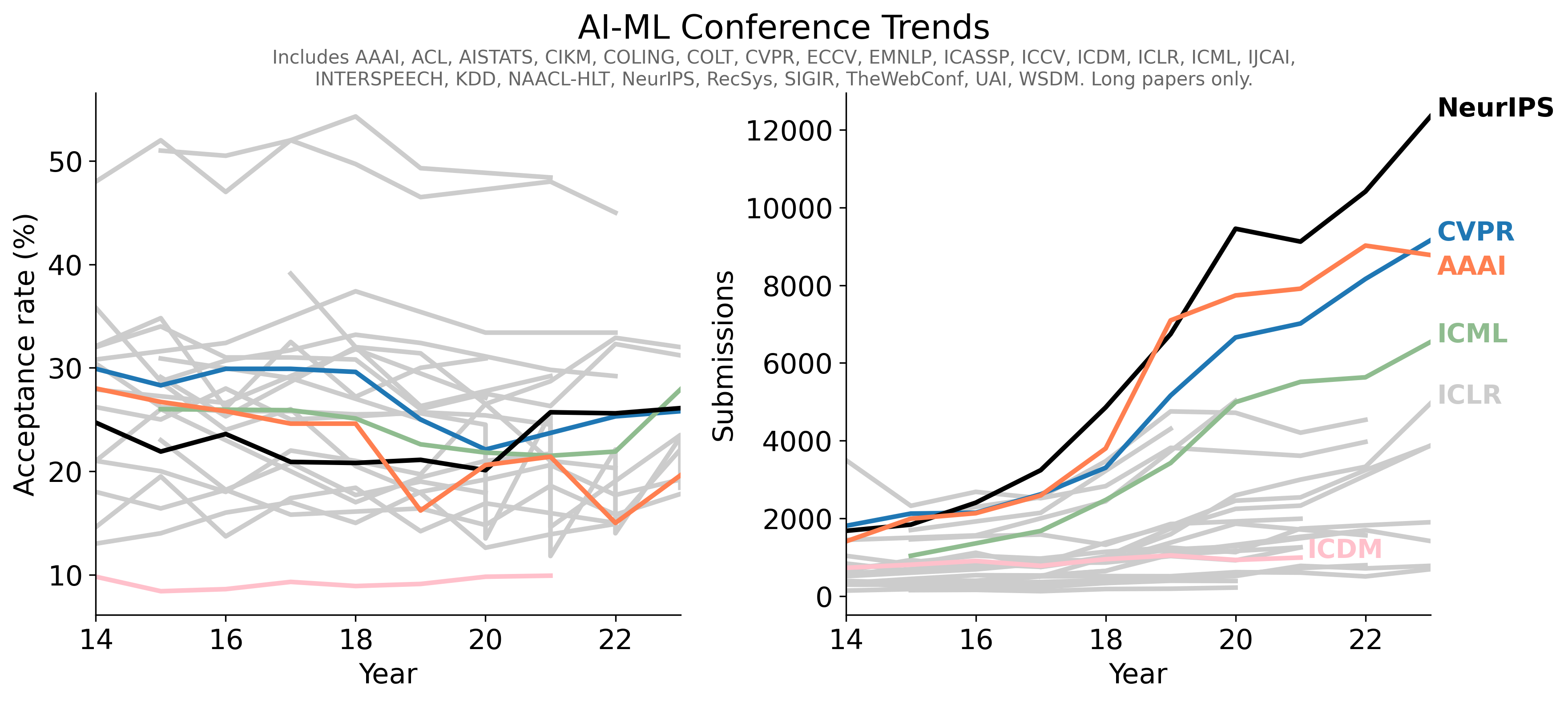

- 1Conference-Acceptance-Rate项目学习指南 - 人工智能顶级会议录用率数据汇总

- 2PaddleSpeech入门学习资料汇总 - 开源语音AI工具包

- 3pot-desktop使用指南 - 跨平台划词翻译和OCR软件

- 4understand-prompt学习资料汇总 - AI助手的探索与应用

- 5GPT4All学习资源汇总 - 在本地设备上运行大型语言模型

- 6law-cn-ai 入门指南 - AI 驱动的中国法律助手

- 7wechat-bot入门指南 - 基于ChatGPT的微信聊天机器人

- 8Cheetah - AI助手学习资料汇总 - Mac应用助力远程技术面试

- 9AI代码翻译器学习资料汇总 - 使用AI将代码从一种语言翻译成另一种语言