GeneFace:通用和高保真度的音频驱动3D人脸合成讲话,高精度还原真人唇语

项目简介

GeneFace可以通过音频来驱动3D的人脸合成唇语讲话视频,是一种通用且高保真度的基于 NeRF 的说话人脸生成方法,可以生成与各种领域外音频相对应的自然结果。具体来说,GeneFace在一个庞大的唇语语料库上学习了一个变分运动生成器,并引入了一个领域自适应后处理网络来校准结果。此外,还学习了一个基于 NeRF 的渲染器,其条件是预测的面部运动。提出了一种头部感知的躯干 NeRF 以消除头部和躯干之间的分离问题。大量实验证明,与先前的方法相比,GeneFace的方法实现了更加通用和高保真度的说话人脸生成。

推理流程

使用方法

在这个发布版本中提供了 GeneFace 的预训练模型和处理过的数据集,以便快速开始。接下来将展示如何在四个步骤中推理预训练模型。如果您想要对自己的目标人员视频训练 GeneFace,请参考以下章节(准备环境,准备数据集和训练模型)。

步骤1:按照 docs/prepare_env/install_guide.md 中的指南创建一个名为 geneface 的新 Python 环境。步骤2:从发布版中下载 lrs3.zip 和 May.zip 并解压到 checkpoints 目录中。步骤3:按照 docs/process_data/process_target_person_video.md 中的指南处理 May.mp4 的数据集。然后您会看到一个名为 data/binary/videos/May/trainval_dataset.npy 的输出文件。完成以上步骤后,您的 checkpoints 和 data 目录的结构应该如下所示:

> checkpoints > lrs3 > lm3d_vae_sync > syncnet > May > lm3d_postnet_sync > lm3d_radnerf > lm3d_radnerf_torso> data > binary > videos > May trainval_dataset.npy步骤4. 运行以下脚本:bash scripts/infer_postnet.shbash scripts/infer_lm3d_radnerf.sh# bash scripts/infer_radnerf_gui.sh # you can also use GUI provided by RADNeRF您可以在 infer_out/May/pred_video 目录中找到一个名为 zozo.mp4 的输出视频。

使用其他目标人物的视频训练 GeneFace

除了此存储库中提供的 May.mp4 之外,GeneFace还提供了在GeneFace实验中使用的其他 8 个目标人物视频。您可以在此链接下载这些视频。要在名为.mp4 的新视频上进行训练,您应将其放置在 data/raw/videos/ 目录下,然后在 egs/datasets/videos/创建一个新文件夹,并根据提供的示例文件夹 egs/datasets/videos/May 修改配置文件。

您还可以录制自己的视频,并为自己训练一个独特的 GeneFace 模型!

项目链接

https://github.com/yerfor/GeneFace

-

下一篇: 最后一页

- GeneFace:通用和高保真度的音频驱动3D人脸合成讲话,高精度还原真人唇语

- Real-Time-Voice-Cloning:AI克隆声音,让声音更懂你

- Microsoft/TrOCR-识别手写文字的利器,让AI在教育领域更进一步

- Nous-Yarn-Mistral-7b-128k:处理长篇文本的先进语言模型,支持128k令牌的语境窗口

- Segmind SSD-1B:SDXL文生图的超能英雄,速度提升60%!

- Whisper JAX:让你的语音转文字功能速度快70倍!

- LCM:苹果Mac终于可以跑SD了,几秒一张XL,喂饭级教学!

- LCM模型:探索AI的新边界,让你1秒出4张图,还有可以体验的网站!好玩!太好玩了!我还要玩!

- Pyannote:揭秘声音的DNA,精准分辨出各个发言者的声音

- DETR:Facebook AI打造的下一代物体检测技术

-

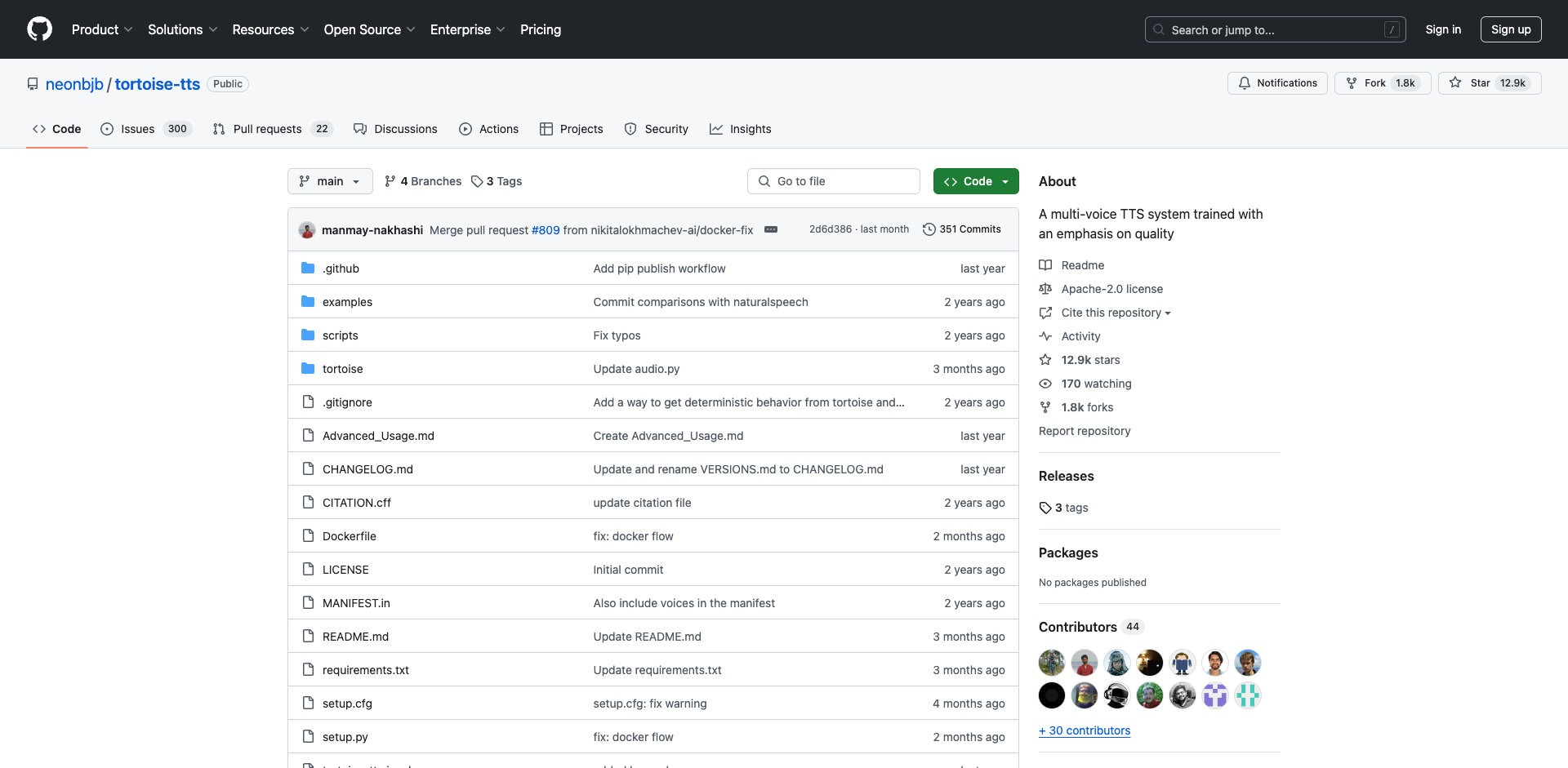

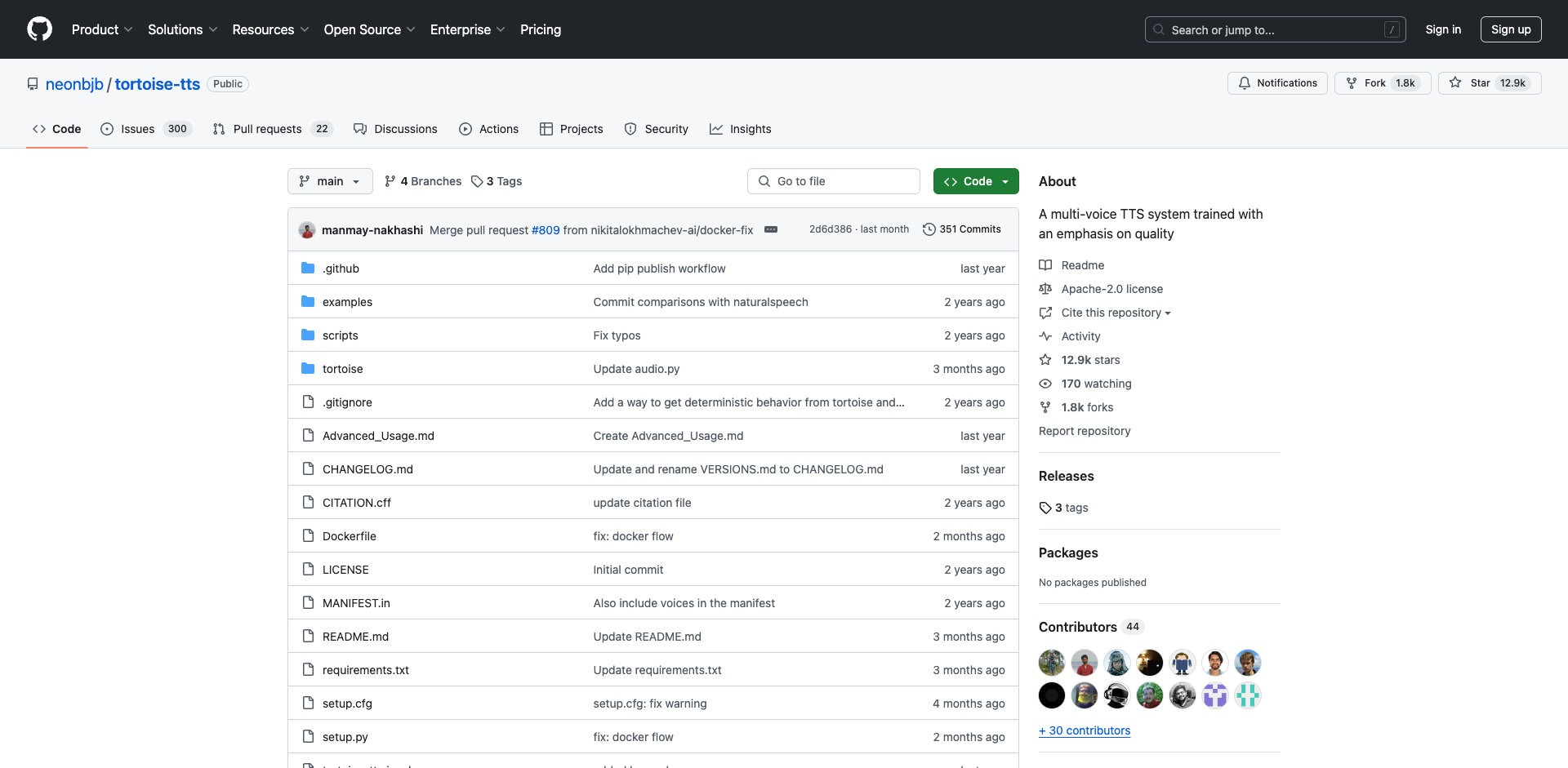

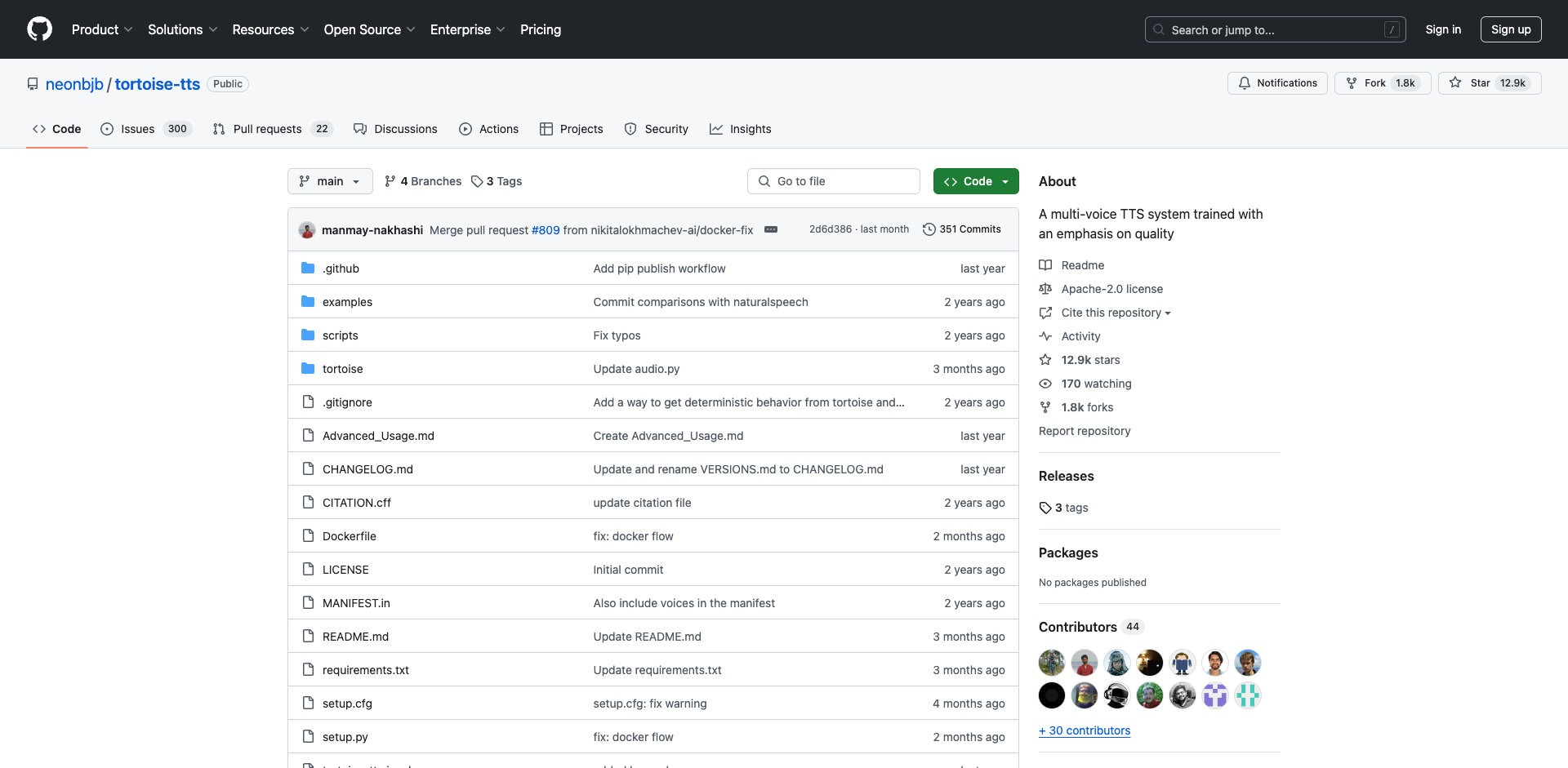

tortoise-tts学习资料汇总 - 高质量多声音TTS系统

2024-12-31

-

-

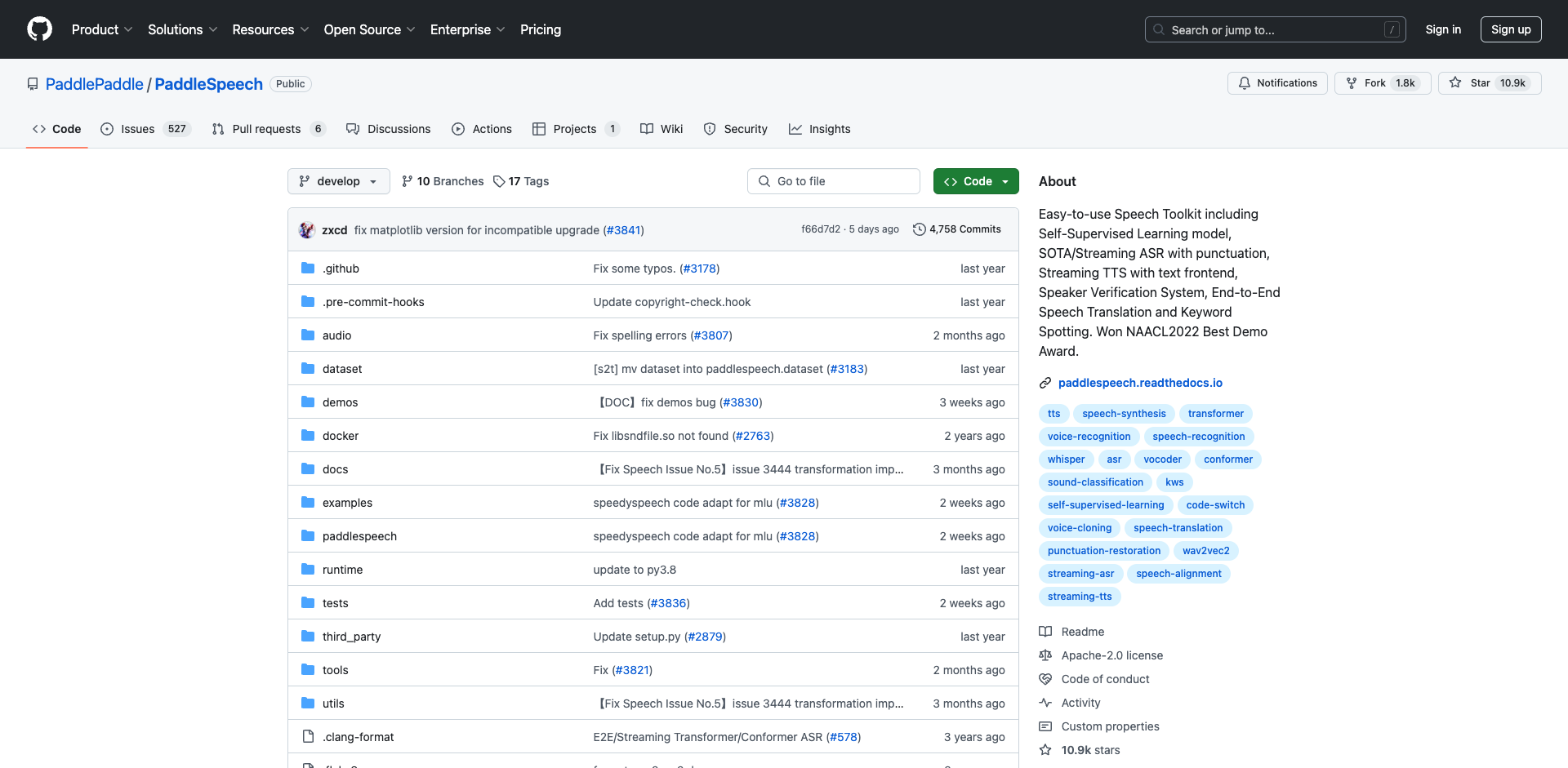

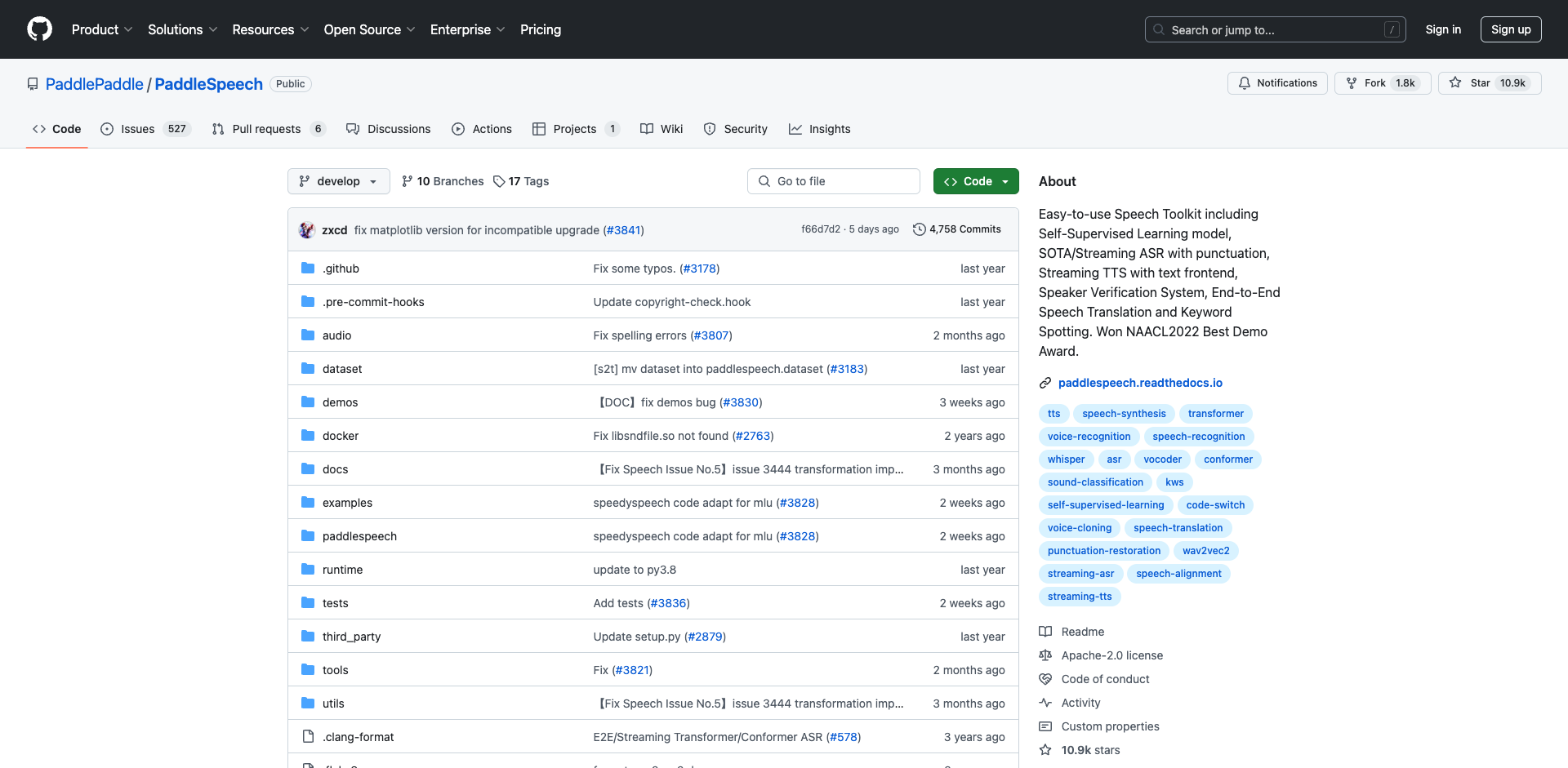

PaddleSpeech入门学习资料汇总 - 开源语音AI工具包

2025-01-02

-

pot-desktop使用指南 - 跨平台划词翻译和OCR软件

2025-01-02

-

understand-prompt学习资料汇总 - AI助手的探索与应用

2025-01-02

-

GPT4All学习资源汇总 - 在本地设备上运行大型语言模型

2025-01-02

-

2025-01-02

-

wechat-bot入门指南 - 基于ChatGPT的微信聊天机器人

2025-01-02

-

Cheetah - AI助手学习资料汇总 - Mac应用助力远程技术面试

2025-01-02

-

AI代码翻译器学习资料汇总 - 使用AI将代码从一种语言翻译成另一种语言

2025-01-02

-

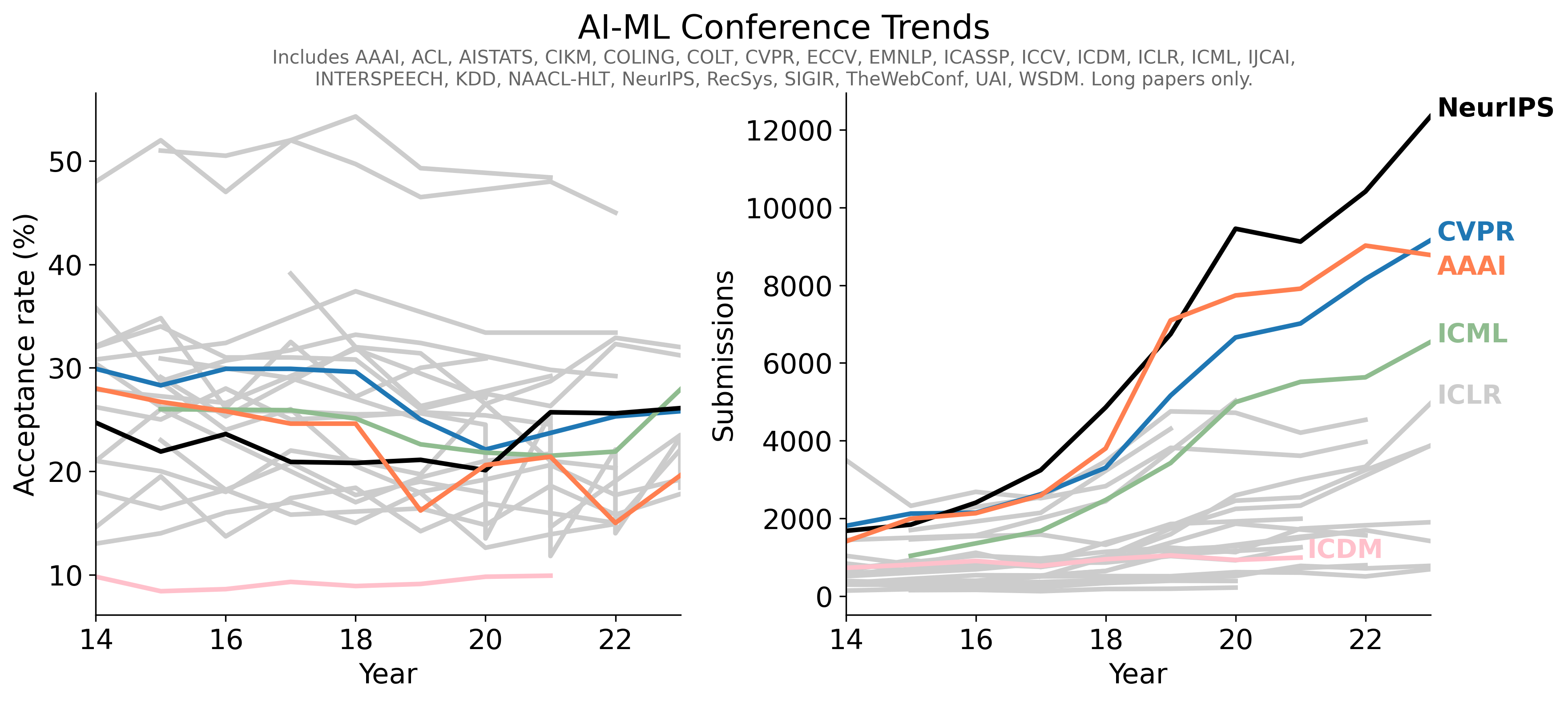

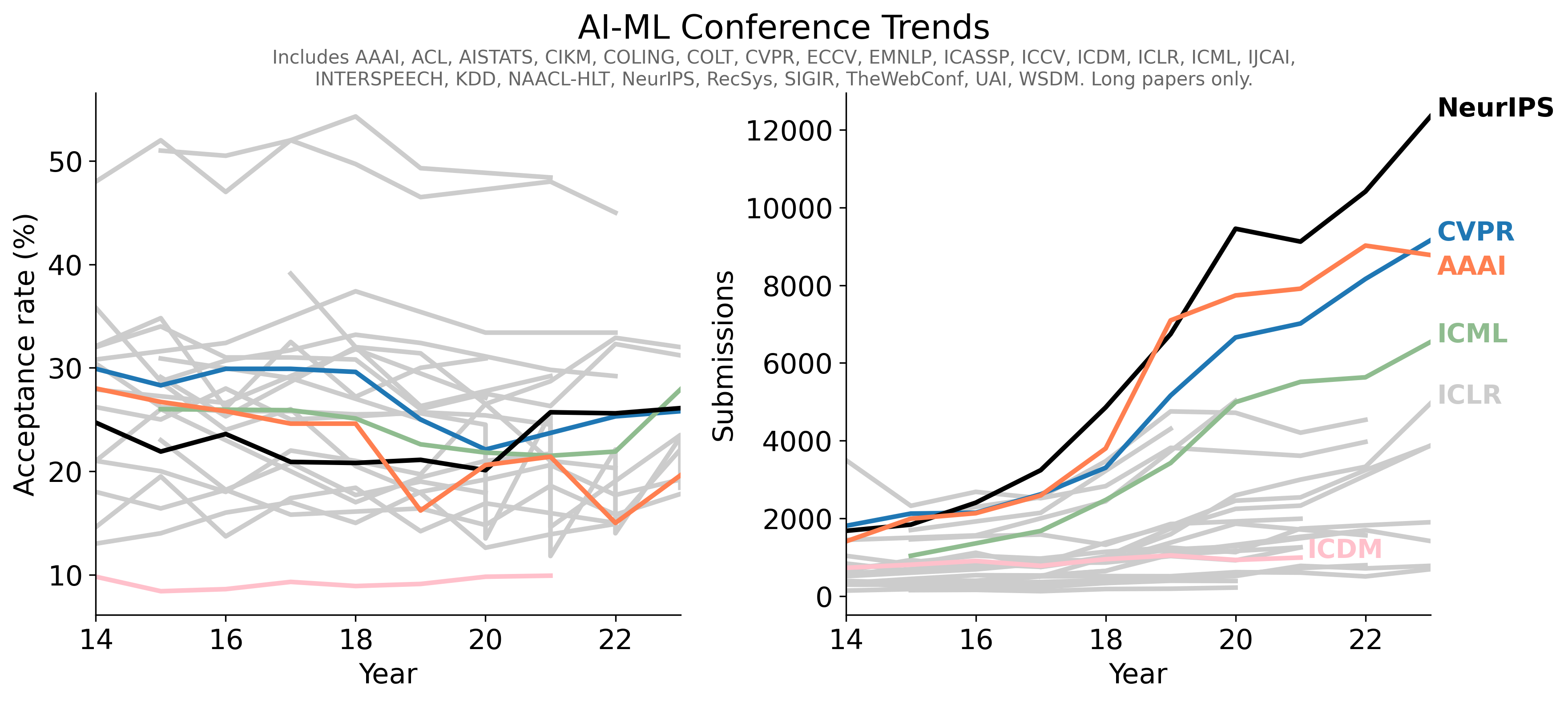

- 1Conference-Acceptance-Rate项目学习指南 - 人工智能顶级会议录用率数据汇总

- 2PaddleSpeech入门学习资料汇总 - 开源语音AI工具包

- 3pot-desktop使用指南 - 跨平台划词翻译和OCR软件

- 4understand-prompt学习资料汇总 - AI助手的探索与应用

- 5GPT4All学习资源汇总 - 在本地设备上运行大型语言模型

- 6law-cn-ai 入门指南 - AI 驱动的中国法律助手

- 7wechat-bot入门指南 - 基于ChatGPT的微信聊天机器人

- 8Cheetah - AI助手学习资料汇总 - Mac应用助力远程技术面试

- 9AI代码翻译器学习资料汇总 - 使用AI将代码从一种语言翻译成另一种语言